LLM-Copilots in ERP-Systemen: Eine Analyse von Nutzungspotenzialen, Risikofaktoren und quantifizierbaren Messmethoden

Harald Konnerth

Lesen Sie:

- wie LLM-basierte KI-Copilots die Interaktion mit ERP-Systemen fundamental verändern

- welche Risiken die Einführung von KI-Copilots birgt und wie der Erfolg einer LLM-Copilot-Implementierung gemessen werden kann

Die Integration von Large Language Models (LLMs) in Enterprise-Resource-Planning-Systeme (ERP) leitet einen Paradigmenwechsel in der Mensch-Maschine-Interaktion ein. Diese Entwicklung transzendiert inkrementelle Funktionserweiterungen und etabliert eine neue Form der Zusammenarbeit, die das Potenzial hat, die Effizienz und strategische Agilität von Organisationen nachhaltig zu steigern. An die Stelle starrer, menügeführter Benutzeroberflächen tritt eine dynamische, konversationelle und kontextsensitive Interaktionsebene. Die als „Copilots“ (z. B. Microsoft Copilot, SAP Joule) bezeichneten Systeme werden strategisch als Werkzeuge zur Erweiterung menschlicher Fähigkeiten positioniert, nicht zu deren Ersatz. Dieser Ansatz, der den Menschen in der Kontrollinstanz belässt, fördert die Nutzerakzeptanz und mindert organisatorische Widerstände. Die Konsequenz ist eine Verschiebung im Change Management: weg von der Sorge um Arbeitsplatzverluste hin zur Weiterqualifizierung für eine effektive Mensch-Maschine-Kollaboration [1, 2]. Letztlich fungieren LLM-Copilots als Katalysatoren für die organisatorische Weiterentwicklung, indem sie die Kernziele von ERP-Systemen – Prozessoptimierung, Effizienzsteigerung und datengestützte Entscheidungsfindung – auf ein neues Niveau heben.

KI-Copilots gestalten die tägliche Arbeit mit Unternehmenssoftware von Grund auf neu. Sie sind weit mehr als reine Automatisierungshelfer – sie werden zu intelligenten Partnern, die bei komplexen Analysen und strategischen Planungen unterstützen. Ihr Nutzen zeigt sich in drei Kernbereichen:

Mehr Effizienz im Arbeitsalltag: Ein entscheidender Vorteil ist die Automatisierung von Routineaufgaben. Tätigkeiten wie die manuelle Dateneingabe, das Erstellen von Standardberichten oder die Rechnungsprüfung, die viel Zeit binden, können von der KI übernommen werden. Das entlastet Fachkräfte spürbar und schafft Freiräume für anspruchsvollere, strategische Aufgaben, die echten Mehrwert schaffen.

Datenzugriff für alle: Die KI-Assistenten wirken wie ein Übersetzer zwischen Mensch und Maschine und machen komplexe ERP-Daten für jeden im Unternehmen zugänglich. Mitarbeitende müssen keine Systemexperten mehr sein oder SQL beherrschen. Eine einfache Frage in Alltagssprache genügt, zum Beispiel: „Zeige mir die Umsatzentwicklung für Produktgruppe A in der Region Süd“. Der Assistent versteht die Frage, sucht die passenden Daten heraus und präsentiert die Antwort klar und verständlich. Auf diese Weise können Entscheidungen im gesamten Unternehmen auf einer soliden Datengrundlage getroffen werden.

Fundiertere Entscheidungen treffen: Generative KI erweitert die analytischen Fähigkeiten von ERP-Systemen entscheidend. Statt nur in die Vergangenheit zu blicken, ermöglichen die neuen Systeme auch Prognosen, die Simulation von „Was-wäre-wenn“-Szenarien oder das Aufspüren unauffälliger Muster in großen Datenmengen.

Das markiert einen fundamentalen Wandel: Während frühere KI-Anwendungen wie RPA vor allem darauf abzielten, repetitive Aufgaben zu automatisieren, bieten die neuen Assistenten eine echte kognitive Unterstützung bei komplexen Denk- und Planungsprozessen.

Anwendungsfälle nach Funktionsbereich

Die transformative Wirkung von LLM-Copilots lässt sich anhand konkreter Anwendungsfälle in zentralen Unternehmensbereichen illustrieren:

Finanzwesen: Beschleunigung des Procure-to-Pay-Prozesses durch automatisierte Rechnungsverarbeitung. Unterstützung des Controllings durch die Erstellung narrativer Managementberichte mit kontextualisierten Kennzahlen.

Supply Chain Management (SCM): Verbesserung der Absatzprognosen durch Analyse externer Marktsignale. Simulation von Szenarien zur vorbeugenden Instandhaltung und Generierung intelligenter Lieferantenempfehlungen.

Personalwesen (HR): Automatisierung von Routineanfragen von Mitarbeitenden (z. B. zu Urlaubsansprüchen) und Unterstützung von Führungskräften bei der Erstellung von Stellenbeschreibungen oder Leistungsbeurteilungen.

Softwareentwicklung und Customizing: Beschleunigung der ERP-Anpassung durch Generierung von Code-Snippets und Unit-Tests (z. B. in ABAP), was den Entwicklungsaufwand reduziert und die Code-Qualität verbessert.

Architektonische Paradigmen und Implementierungen führender ERP-Anbieter

Die führenden ERP-Anbieter SAP, Microsoft und Oracle gehen bei der Einführung ihrer KI-Copilots jeweils eigene Wege. Ihre Strategien unterscheiden sich vor allem darin, wie tief die Assistenten in die Software integriert sind, auf welche Weise sie auf Unternehmensdaten zugreifen und welche Möglichkeiten zur individuellen Anpassung bestehen. Diese Unterschiede sind für Unternehmen relevant, da sie die Flexibilität und die Abhängigkeit vom jeweiligen Ökosystem beeinflussen.

SAP Joule: Das agentische Paradigma

SAP positioniert Joule als eine „agentische Plattform“. Spezialisierte KI-Agenten können komplexe, mehrstufige Geschäftsprozesse (z. B. Umplanung von Lieferketten) autonom über verschiedene Systeme hinweg orchestrieren. Die Datenanbindung (Grounding) erfolgt mittels Retrieval-Augmented Generation (RAG) auf Basis eines Katalogs von Systemfähigkeiten und Unternehmenswissen, wobei die Berechtigungen der Nutzer strikt eingehalten werden. Die Erweiterbarkeit wird durch die SAP Business Technology Platform (BTP) und das Joule Studio sichergestellt [3].

Microsoft Copilot: Tiefgreifende Ökosystem-Integration

Microsofts Strategie ist die nahtlose Integration des Copiloten in das gesamte Microsoft-365-Ökosystem (Dynamics 365, Word, Teams etc.). Als zentrale Komponente für die Datenanbindung dient der Microsoft Graph, der den gesamten Unternehmenskontext aus E-Mails, Dokumenten, Chats und ERP-Daten aggregiert. Dies ermöglicht hochgradig kontextualisierte Antworten unter Beachtung der bestehenden Nutzerberechtigungen. Die Anpassung erfolgt über das Copilot Studio auf der Power Platform.

Tab. 1: Vergleichende Übersicht der LLM-Copilot-Architekturen.

Oracle AI: Eingebettete, funktionsspezifische Intelligenz

Oracle fokussiert auf die Einbettung spezialisierter KI-Funktionen direkt in die Oracle Fusion Cloud Applications, um „Touchless Operations“ zu realisieren. Statt eines generalistischen Assistenten setzt Oracle auf spezifische Agenten (z. B. zur Dokumentenverarbeitung). Das Grounding erfolgt nativ auf den Daten innerhalb des Oracle-Ökosystems. Die Oracle Cloud Infrastructure (OCI) bietet zudem Plattformen für Fine-Tuning und die Entwicklung eigener KI-Lösungen [4] (Tabelle 1).

Identifikation und Mitigation inhärenter Risiken

Die Einführung von KI-Copilots in geschäftskritische ERP-Systeme bringt Risiken mit sich, für die klassische Sicherheitskonzepte nicht gemacht sind. Die unberechenbare, sprachbasierte Arbeitsweise der KI verlangt eine grundlegend neue Auseinandersetzung mit dem Thema Sicherheit, um einen verantwortungsvollen Einsatz zu gewährleisten.

Datensicherheit und Datenschutz in RAG-Architekturen

Retrieval-Augmented Generation (RAG) ist eine Schlüsseltechnologie, um KI-Assistenten mit verlässlichen Unternehmensdaten zu verbinden, schafft aber gleichzeitig neue Sicherheitsrisiken. So kann die Speicherung sensibler Informationen in speziellen Vektor-Datenbanken neue Lücken in der Abwehr eröffnen. Ein weiteres Problem: Oft fehlen in diesen Systemen die feingliedrigen Zugriffsberechtigungen, die aus ERP-Systemen bekannt sind. Dadurch könnten Mitarbeitende durch geschickt formulierte Fragen an Informationen gelangen, die sie eigentlich nicht sehen dürften.

Um diese Risiken zu minimieren, sind durchgehende Zugriffskontrollen im gesamten Datenprozess unerlässlich – von der Quelle bis zur finalen Antwort der KI. Wichtig sind zudem technische Vorkehrungen wie die automatische Unkenntlichmachung persönlicher Daten und die strikte Einhaltung gesetzlicher Vorschriften (z. B. Datenspeicherung innerhalb der EU).

KI-Halluzinationen und Informationsintegrität

Ein inhärentes Risiko von LLMs ist die Generierung plausibler, aber sachlich falscher Informationen („Halluzinationen“). Im ERP-Kontext können fehlerhafte Finanzberichte oder strategische Empfehlungen gravierende finanzielle und rechtliche Folgen haben.

Der zentrale Lösungsansatz besteht in einem konsequenten Grounding des LLMs an hochwertige, aktuelle Unternehmensdaten mittels RAG. Zusätzlich helfen gezieltes Prompt Engineering und das Fine-Tuning von Modellen auf domänenspezifische Daten. Für alle geschäftskritischen Prozesse bleibt jedoch eine strikte menschliche Überwachung (Human-in-the-Loop) zur Validierung der Ergebnisse unerlässlich.

Prompt-Injection-Angriffe: Eine neue Bedrohungsklasse

Prompt-Injection-Angriffe, bei denen bösartige Anweisungen in Nutzereingaben eingebettet werden, stellen eine neuartige und schwer zu kontrollierende Bedrohung dar (von OWASP als Top-Risiko eingestuft). Ziel ist es, die ursprünglichen Systemanweisungen zu überschreiben und den Copiloten zu unerwünschten Aktionen zu verleiten, beispielsweise zur Preisgabe sensibler Daten oder der Ausführung nicht autorisierter Transaktionen [5].

Zur Risikominderung ist ein mehrschichtiger Verteidigungsansatz notwendig. Zu den Kernstrategien gehören die Validierung von Eingaben, die strikte Trennung von System- und Nutzerdaten sowie der Einsatz von KI-gestützten Filtern (Guardrails). Da eine absolute Sicherheit nicht erreichbar ist, stellt dies eine andauernde Bedrohung dar.

Dies bedeutet einen Paradigmenwechsel für die Sicherheit von ERP-Systemen: Die Angriffsvektoren verschieben sich von codebasierten Lücken hin zur sprachlichen Manipulation der KI. Sicherheitsteams müssen daher Kompetenzen in neuen Feldern wie Adversarial Prompting oder der KI-Verhaltensanalyse aufbauen.

Ein Framework zur Messung von Produktivität und Qualität

Die Bewertung des Erfolgs einer LLM-Copilot-Implementierung erfordert ein strukturiertes und mehrdimensionales Vorgehen. Sich ausschließlich auf einfache Effizienzkennzahlen wie die reine Zeitersparnis zu verlassen, ist unzureichend und kann zu irreführenden Schlussfolgerungen über den tatsächlichen Wertbeitrag führen. Ein ganzheitliches KPI-Framework, das neben der Prozesseffizienz auch die Ergebnisqualität, die Nutzerakzeptanz und den übergeordneten Geschäftswert berücksichtigt, ist für eine fundierte Evaluation unerlässlich. Die Messung muss dabei stets kontextbezogen erfolgen und Faktoren wie die spezifische Aufgabe und das Qualifikationsniveau der Anwender einbeziehen.

Das nachfolgende Gerüst bietet eine strukturierte Grundlage zur Erfolgsmessung von LLM-Copilots im ERP-Umfeld. Es ist als Balanced Scorecard konzipiert, die es Organisationen ermöglicht, eine datengestützte Governance für ihre KI-Initiativen zu etablieren und den Return on Investment (ROI) umfassend zu bewerten [6].

Tab. 2: KPI-Gerüst zur Erfolgsmessung von LLM-Copilots im ERP-Umfeld: Prozesseffizienz.

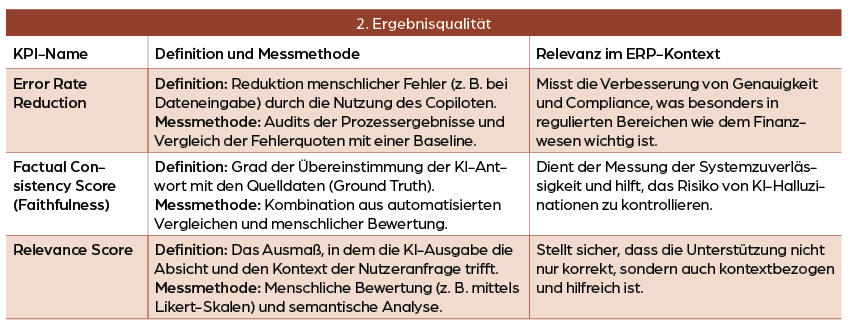

Tab. 3: KPI-Gerüst zur Erfolgsmessung von LLM-Copilots im ERP-Umfeld: Ergebnisqualität.

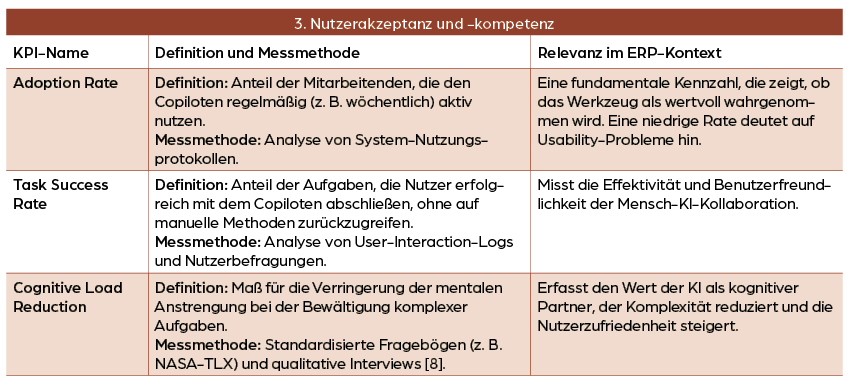

Tab. 4: KPI-Gerüst zur Erfolgsmessung von LLM-Copilots im ERP-Umfeld: Nutzerakzeptanz und -kompetenz.

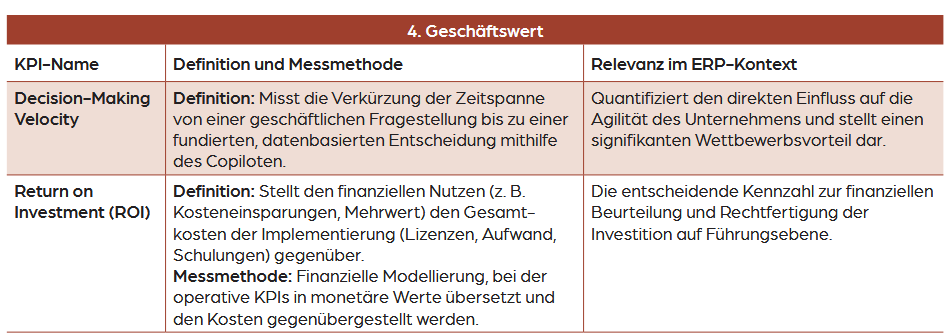

Tab. 5: KPI-Gerüst zur Erfolgsmessung von LLM-Copilots im ERP-Umfeld: Geschäftswert.

Als Professor für Prozesse und Systeme an der FH Oberösterreich in Steyr liegen die Schwerpunkte von Harald Konnerth auf betrieblichen Informations-systemen und Datenmanagement. Diese Expertise setzt er auch als Geschäftsführer praktisch um, indem er Unternehmen bei der Implementierung von ERP-Systemen und bei der digitalen Prozessautomatisierung unterstützt.

DI (FH) Harald Konnerth MBA

Upper Austria University of Applied Sciences

FH OÖ Studienbetriebs GmbH

Wehrgrabengasse 1-3, 4400 Steyr, Österreich

Tel.: +43 664 2268190

E-Mail: harald.konnerth@fh-steyr.at